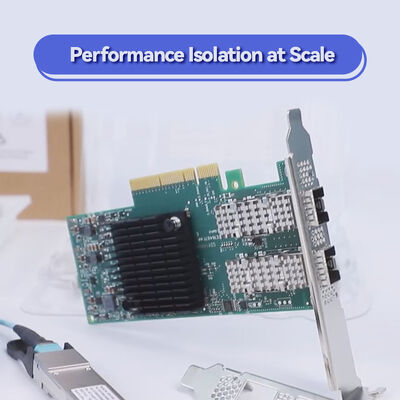

NVIDIA mellanox ConnectX-6 MCX653106A-ECAT 100Gb/s Dual-Port InfiniBand Adapter Ethernet

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX653106A-ECAT |

| Dokument: | connectx-6-infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| stan produktów: | Magazyn | Aplikacja: | Serwer |

|---|---|---|---|

| Typ interfejsu:: | Infiniband | Porty: | Podwójny |

| Maksymalna prędkość: | 100 gbe | Typ: | Przewodowy |

| Stan: | Nowe i oryginalne | Czas gwarancji: | 1 rok |

| Model: | MCX653106A-ECAT | Nazwa: | MCX653106A-ECAT Mellanox 100 GB Nic ConnectX- 6 VPI Hdr100 Edr Ib podwójny port |

| Słowo kluczowe: | Karta sieciowa Mellanox | ||

| Podkreślić: | Adapter sieciowy Mellanox ConnectX-6,Karta Ethernet InfiniBand 100 Gb/s,dwuportowa karta sieciowa Mellanox |

||

opis produktu

Wszechstronna dwuportowa karta adaptera InfiniBand i Ethernet 100Gb/s z interfejsem PCIe 3.0/4.0 x16 — zapewniająca RDMA, odciążenia NVMe-oF, szyfrowanie na poziomie blokowym i obliczenia w sieci dla zoptymalizowanych pod kątem kosztów wdrożeń HPC, korporacyjnych i chmurowych.

- Dwuportowa łączność InfiniBand (EDR/HDR100) i 100/50/40/25/10GbE 100Gb/s

- PCIe Gen 3.0/4.0 x16 (kompatybilność wsteczna) | Do 215 milionów wiadomości na sekundę

- Odciążenia sprzętowe: cel/inicjator NVMe-oF, szyfrowanie XTS-AES 256/512-bitowe, dopasowywanie tagów MPI

- Obsługa obliczeń w sieci NVIDIA i GPUDirect RDMA

- Niskoprofilowy format PCIe stand-up, zgodny z RoHS

- Przepustowość 100Gb/s: Dwa porty działające z prędkością do 100Gb/s InfiniBand (EDR/HDR100) lub Ethernet z pełną dwukierunkową przepustowością.

- Obliczenia w sieci: Odciążenia operacji zbiorczych (MPI, NCCL, SHMEM) przy użyciu technologii NVIDIA SHARP.

- Szyfrowanie na poziomie blokowym: Sprzętowe szyfrowanie/deszyfrowanie AES-XTS 256/512-bitowe bez obciążenia procesora; zgodne z FIPS.

- Odciążenia NVMe-oF: Odciążenia celu i inicjatora dla NVMe over Fabrics, zmniejszające wykorzystanie procesora.

- Zaawansowana wirtualizacja: SR-IOV do 1K VF, akceleracja ASAP² dla OVS i wirtualnego przełączania.

MCX653106A-ECAT integruje silniki obliczeniowe w sieci NVIDIA (SHARP), RDMA (IBTA 1.3), RoCE i NVMe-oF. Obsługuje PCIe Gen 4.0 (x16) i Gen 3.0, SerDes PAM4 i NRZ oraz zaawansowane funkcje, takie jak Dynamically Connected Transport (DCT), On-Demand Paging (ODP) i Adaptive Routing. Odciążenia nakładkowe dla VXLAN, NVGRE, Geneve są akcelerowane sprzętowo. Zgodność ze specyfikacjami IEEE 802.3bj, 802.3bm, 802.3by i InfiniBand Trade Association.

ConnectX-6 odciąża zadania komunikacyjne i związane z przechowywaniem danych z procesora hosta do sprzętu adaptera. W przypadku operacji zbiorczych MPI adapter przetwarza dane w locie za pomocą SHARP, zmniejszając ruch końcowy. W przypadku przechowywania danych polecenia NVMe-oF są przetwarzane bezpośrednio na adapterze, zwalniając rdzenie procesora. Szyfrowanie/deszyfrowanie blokowe odbywa się w linii przy prędkości sieciowej. Rezultatem jest niższe opóźnienie, wyższa liczba wiadomości (215 Mpps) i lepsza skalowalność aplikacji—nawet przy prędkościach 100Gb/s.

- Średniej wielkości klastry HPC: Symulacje oparte na MPI wymagające opłacalnego interkonektu 100Gb/s.

- Wnioskowanie i szkolenie AI: Klastry GPU z GPUDirect RDMA i operacjami zbiorczymi NCCL.

- Przechowywanie danych NVMe-oF: Odciążenie celu/inicjatora dla wysokowydajnego dostępu do pamięci masowej NVMe.

- Wirtualizowane centra danych: SR-IOV i ASAP² dla odciążenia OVS w NFV i chmurze.

- Chmura korporacyjna: Łączność 100Gb Ethernet dla wirtualizacji i konwergencji pamięci masowej.

| Model | Porty i prędkość | Interfejs hosta | Format | Szyfrowanie | Protokoły | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (100Gb/s IB/Eth) | PCIe 3.0/4.0 x16 | PCIe stand-up (niski profil) | AES-XTS 256/512-bit | InfiniBand, Ethernet, NVMe-oF | MCX653106A-ECAT |

| ConnectX-6 | 1x QSFP56 (100Gb/s) | PCIe 4.0 x8 | PCIe stand-up | AES-XTS | IB/Eth | MCX651105A-EDAT |

| ConnectX-6 | 2x QSFP56 (200Gb/s) | PCIe 4.0 x16 | PCIe stand-up | AES-XTS | IB/Eth | MCX653106A-HDAT |

Uwaga: MCX653106A-ECAT obsługuje InfiniBand 100Gb/s (EDR/HDR100) oraz 100/50/25/10GbE. Wymiary: 167,65 mm x 68,90 mm (bez wspornika). Zawiera wysoki wspornik (akcesorium w postaci krótkiego wspornika). Zużycie energii < 15W typowo.

- w porównaniu do ConnectX-5: Podwójna przepustowość (100Gb/s vs 50Gb/s), zintegrowany SHARP do obliczeń w sieci i szyfrowanie na poziomie blokowym bez dodatkowych kosztów.

- w porównaniu do konkurencyjnych kart sieciowych: Prawdziwe odciążenie sprzętowe dla NVMe-oF i operacji zbiorczych MPI — nie tylko odciążenia bezstanowe.

- Zoptymalizowane pod kątem kosztów 100G: Idealne do równoważenia wydajności i budżetu w średniej wielkości klastrach.

- Zgodność z FIPS: Szyfrowanie sprzętowe spełnia rządowe standardy bezpieczeństwa.

Oferujemy całodobowe konsultacje techniczne, usługi RMA i wsparcie integracyjne dla adapterów ConnectX-6. Każda karta objęta jest roczną gwarancją (z możliwością przedłużenia). Nasz zespół zapewnia walidację sterowników dla głównych dystrybucji Linuksa, Windows i VMware. Dostępna jest pomoc w konfiguracji przed sprzedażą w zakresie projektowania sieci InfiniBand/Ethernet.

P: Czy MCX653106A-ECAT jest kompatybilny ze przełącznikami Quantum 200Gb/s?

O: Tak, jest interoperacyjny z przełącznikami NVIDIA Quantum QM8700/QM8790 przy użyciu trybu HDR100 (100Gb/s na port).

P: Czy ten adapter może być używany zarówno do Ethernetu, jak i InfiniBand?

O: Tak, obsługuje oba protokoły InfiniBand i Ethernet. Oprogramowanie układowe automatycznie wykrywa typ przełącznika i konfiguruje odpowiedni tryb.

P: Czy obsługuje RoCE (RDMA over Converged Ethernet)?

O: Tak, ConnectX-6 w pełni obsługuje RoCE, zapewniając niskie opóźnienia RDMA w środowiskach Ethernet.

P: Jaka jest maksymalna liczba wiadomości na sekundę?

O: Adapter dostarcza do 215 milionów wiadomości na sekundę, co jest idealne dla obciążeń HPC z małymi pakietami.

P: Czy karta jest kompatybilna ze slotami PCIe Gen 3.0?

O: Tak, jest w pełni kompatybilna ze slotami PCIe Gen 3.0 x16; wydajność będzie ograniczona do ~100Gb/s sumarycznie, co odpowiada prędkości portu.

- Wymagania dotyczące slotu PCIe: Aby uzyskać optymalną wydajność, zainstaluj w slocie PCIe Gen 3.0 x16 lub Gen 4.0 x8/x16.

- Chłodzenie: Zapewnij odpowiedni przepływ powietrza w obudowie serwera; chłodzenie pasywne wymaga minimum 200 LFM.

- Okablowanie: Używaj modułów QSFP56 miedzianych pasywnych/aktywnych lub optycznych o prędkości 100Gb/s (EDR/HDR100).

- Obsługa sterowników: Używaj najnowszego NVIDIA MLNX_OFED dla Linuksa lub WinOF-2 dla Windows.

- Temperatura pracy: 0°C do 70°C; przechowywać w temperaturze od -40°C do 85°C.

Z ponad dziesięcioletnim doświadczeniem, posiadamy fabrykę na dużą skalę wspieraną przez silny zespół techniczny. Nasza rozległa baza klientów i wiedza domenowa pozwalają nam oferować konkurencyjne ceny bez kompromisów w zakresie jakości. Jako autoryzowani dystrybutorzy Mellanox, Ruckus, Aruba i Extreme, posiadamy w magazynie oryginalne przełączniki sieciowe, rozwiązania kart sieciowych (NIC), punkty dostępowe Wi-Fi, kontrolery i okablowanie. Utrzymujemy zapasy o wartości 10 milionów USD, aby zapewnić szybką realizację zamówień w różnych liniach produktowych. Każda przesyłka jest weryfikowana pod kątem dokładności, a my zapewniamy całodobowe konsultacje i wsparcie techniczne. Nasze profesjonalne zespoły sprzedaży i techniczne zdobyły wysoką reputację na rynkach światowych — nawiąż z nami współpracę w celu uzyskania niezawodnych rozwiązań infrastrukturalnych.