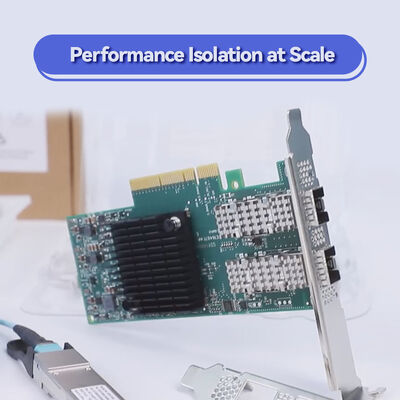

NVIDIA ConnectX-7 NDR 400Gb/s InfiniBand Adapter MCX75310AAS-HEAT

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX75310AAS-Heat (900-9x766-003n-ST0) |

| Dokument: | Connectx-7 infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| Nr modelu: | MCX75310AAS-Heat (900-9x766-003n-ST0) | Porty: | Pojedynczy port |

|---|---|---|---|

| Technologia: | Infiniband | Typ interfejsu: | OSFP56 |

| Specyfikacja: | 16,7 cm x 6,9 cm | Pochodzenie: | Indie / Izrael / Chiny |

| szybkość transmisji: | 200 Gbe | Interfejs hosta: | Gen3 X16 |

opis produktu

Ultra-niskie opóźnienie RDMA sieci dla fabryk AI, klastrów HPC i chmury hiperskałowej.przyspieszenie bezpieczeństwa sprzętu, a GPUDirect® Gotowy do przechowywania.

Rodzina NVIDIA ConnectX-7 redefiniuje połączenia między centrami danych z przepustowością do 400 Gb/s, niezawodnym transportem opartym na sprzęcie i zaawansowanym obliczeniem w sieci.MCX75310AAS-HEATnależy do serii adapterów ConnectX-7 VPI obsługujących zarówno InfiniBand (NDR/HDR/EDR) jak i Ethernet (400GbE do 10GbE).zapewnia opóźnienie poniżej mikrosekundy i uwalnia rdzenie procesora za pośrednictwem silników przyspieszenia w celu zapewnienia bezpieczeństwa, wirtualizacji i NVMe-oF. Dzięki interfejsowi hosta PCIe Gen5 adapter ten maksymalizuje przepływ danych dla klastrów GPU i środowisk handlowych o wysokiej częstotliwości.

Wykorzystując ASAP2 (Accelerated Switch and Packet Processing) i Zero-Touch RoCE, adapter upraszcza wdrażanie, zapewniając jednocześnie szyfrowanie sprzętu w linii ′′ od krawędzi do rdzenia.Przedsiębiorstwa mogą zabezpieczyć swoją infrastrukturę z wykorzystaniem szybkości NDR i elastycznego wsparcia dla wielu hostów.

Podwójny port NDR 400Gb/s InfiniBand lub 400GbE, PCIe Gen5 x16 (do 32 pasów).

SHARPv3 zbiorowe operacje rozładunek, protokół rendezvous rozładunek, pamięć pokładowa dla wybuchów.

Inline IPsec/TLS/MACsec AES-GCM 128/256-bit, bezpieczne uruchamianie z hardware root-of-trust, szyfrowanie flash.

IEEE 1588v2 PTP (12ns dokładności), SyncE, klasa C G.8273.2, wyzwalający tempo.

GPUDirect RDMA, GPUDirect Storage, NVMe-oF offload, przekazanie podpisu T10-DIF.

VXLAN, GENEVE, NVGRE, programowalny elastyczny analizator, śledzenie połączeń (firewall L4).

NVIDIA ASAP2 (Accelerated Switch and Packet Processing) odładowuje całe ścieżki danych, zapewniając wydajność SDN z zerowym obciążeniem procesora.Strona internetowa na życzenie (ODP), rejestracja trybu użytkownika (UMR) i usługi tłumaczenia adresów (ATS) dla efektywnych obciążeń kontenerowych.adapter umożliwia wykonanie bare-metal w wirtualizowanych środowiskachNapędowy silnik RoCE zapewnia wdrożenie zero-touch dla konwergowanych tkanin Ethernet, podczas gdy pamięć sieciowa zmniejsza opóźnienie dla bibliotek MPI i komunikacji zbiorowej (NVIDIA HPC-X, UCX,NCCL).

Aby rozwiązać problem bezpieczeństwa od krawędzi do rdzenia, silniki kryptografii w linii obsługują IPsec, TLS 1.3, i MACsec bez zużywania rdzeni wykonywania, co czyni go idealnym rozwiązaniem dla chmur multi-tenant i usług finansowych.

- Klustery AI i dużych modeli językowych:RDMA i GPUDirect przyspieszają rozproszone szkolenie na setkach procesorów graficznych.

- Wypożyczalnia wysokiej wydajności (HPC):MPI offloads, SHARPv3 dla redukcji w sieci, adaptive routing.

- Centrum danych w chmurze i na krawędzi:Przyspieszenie sieci, VXLAN, SR-IOV.

- Systemy pamięci masowej (SDS) definiowane oprogramowaniem:NVMe/TCP, NVMe-oF, iSER, NFS przez RDMA.

- Analityka i handel w czasie rzeczywistym:Ultra niskie opóźnienie + synchronizacja klasy C PTP.

| Składnik / Ekosystem | Opcje obsługiwane |

|---|---|

| Interfejs hosta | PCIe Gen5 (do pasów x32, typowe dla x16), bifurkacja PCIe, Multi-Host (4 hosta) |

| Systemy operacyjne | Linux (RHEL, Ubuntu, sterowniki w pakiecie), Windows Server, VMware ESXi (SR-IOV), Kubernetes |

| Wirtualizacja i pojemniki | SR-IOV, przyspieszenie VirtIO, NVMe przez TCP w przypadku kontenerów |

| HPC Middleware / Biblioteki | OpenMPI, MVAPICH, MPICH, UCX, NCCL, UCC, OpenSHMEM, PGAS |

| Protokoły przechowywania | NVMe-oF (RDMA/TCP), SRP, iSER, NFS przez RDMA, SMB Direct, GPUDirect Storage |

| Parametry | Specyfikacja |

|---|---|

| Model produktu | MCX75310AAS-HEAT |

| Czynniki formy | PCIe HHHL / FHHL, OCP 3.0 SFF/TSFF (patrz przewodnik zamówienia) |

| Prędkości InfiniBand | NDR 400 Gb/s, HDR 200 Gb/s, EDR 100 Gb/s |

| Prędkości Ethernet | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE (NRZ/PAM4) |

| Porty sieciowe | konfiguracje portów 1/2/4 (zależne od SKU; 2-port typowy dla tego modelu) |

| Autobus gospodarza | PCI Express Gen 5.0 (kompatybilny z Gen4/Gen3), do pasów x32, wskazówki przetwarzania TLP, ATS, PASID |

| Bezpieczeństwo | Inline IPsec (AES-GCM 128/256), TLS 1.3, MACsec, bezpieczne uruchamianie, szyfrowanie flash, potwierdzenie urządzenia |

| RDMA / Transport | Niezawodny transport sprzętowy, XRC, DCT, paging na żądanie, UMR, GPUDirect RDMA |

| Czas i synchronizacja | IEEE 1588v2 PTP, G.8273.2 klasa C, dokładność 12 ns, syncE, włączenie/wyłączenie PPS, planowanie wywołane czasowo |

| Zarządzanie | NC-SI, MCTP przez PCIe/SMBus, PLDM (DSP0248/0267/0218), SPDM, SPI flash, JTAG |

| Wyrzucić urządzenie | InfiniBand zdalne uruchomienie, iSCSI, UEFI, PXE |

| Otwarte sieci | ASAP2 dla SDN, VXLAN/GENEVE/NVGRE offload, odzwierciedlenie przepływu, hierarchiczne QoS, śledzenie połączeń L4 |

| Energetyka i środowisko | Odwołanie do instrukcji obsługi (typowe ~15W-25W w zależności od konfiguracji), temperatura pracy: od 0°C do 55°C (nie podana publicznie, potwierdzenie w odniesieniu do SKU) |

| Przykład numeru części | Porty / Prędkość | Wskaźnik kształtu | Typowe zastosowanie |

|---|---|---|---|

| MCX75310AAS-HEAT | NDR 400Gb/s podwójny port, PCIe 5.0 x16 | PCIe HHHL / FHHL | Najnowocześniejsze klastry AI i HPC, GPU |

| MCX75340AAS-HEAT (przykład) | 4-port NDR200 / 200GbE | OCP 3.0 | Hiperskala i wieloprzestrzenny |

| Pozostałe SKU ConnectX-7 | Jednorazowy/podwójny port, 100G/200G/400G | OCP, FHHL | Przedsiębiorstwa, urządzenia magazynowe |

W celu uzyskania pomocy w wyborze odpowiedniego SKU (podtrzymanie kable, rodzaj uchwytu, wysoki/krótki uchwyt) skontaktuj się z zespołem Starsurge.

- ✅Części oryginalne i certyfikowane√ pełna gwarancja, bezpieczny łańcuch dostaw.

- ✅Doradztwo w zakresie architektury przedsprzedażowejProjekt klastra HPC / AI, tuning RDMA.

- ✅Globalna logistyka i szybkie realizacje∆ zasoby w Azji/Europie/Amerykach.

- ✅Niestandardowe oprogramowanie napędowe i opcje OEMWymaganie konfiguracji masowej.

- ✅Wsparcie techniczne po sprzedaży Integracja sterowników, aktualizacje oprogramowania, RMA.

Hong Kong Starsurge Group zapewnia pełne wsparcie cyklu życia: od walidacji kompatybilności do wdrożenia i bieżącej konserwacji.

- Projektowanie tkaniny InfiniBand i optymalizacja wydajności.

- Konfiguracja RoCE dla środowisk Ethernet.

- Integracja z GPUDirect Storage i NVMe-oF.

- 3-letnia gwarancja standardowa plus rozszerzone pokrycie dostępne.

Ceny objętościowe, przesyłka hurtowa i dostosowanie (przyczepy, kartki) są dostępne na żądanie.

NDR obejmuje zaawansowane funkcje obliczeniowe w sieci, takie jak SHARP, adaptive routing i niezawodny transport sprzętowy; tryb Ethernet wykorzystuje RoCE do RDMA z tą samą szybkością linii.ConnectX-7 obsługuje zarówno poprzez podwójną osobowość.

Tak, adapter jest kompatybilny z PCIe Gen4 i Gen3, ale przy zmniejszonej prędkości jazdy.

Tak, ConnectX-7 obsługuje technologię NVIDIA Multi-Host, umożliwiającą udostępnianie tego samego adaptera do 4 niezależnych hostów (zależnie od konkretnego SKU i okablowania).

IPsec (AES-GCM 128/256-bit), TLS (AES-GCM 128/256-bit) i MACsec (AES-GCM 128/256-bit).

ConnectX-7 rozładowuje NVMe przez TCP, a także NVMe-oF, zmniejszając koszty przechowywania.

- Zapewnienie prawidłowego przepływu powietrza w podwozie serwera przy użyciu nadajników wysokiej mocy (aktywny system optyczny lub DAC).

- Użyj oprogramowania naprawczego dostarczonego przez NVIDIA lub zatwierdzonego przez Starsurge w celu naprawy zabezpieczeń.

- Zainstalować najnowszy sterownik (MLNX_OFED lub native inbox), aby umożliwić pełne wyładowanie sprzętu.

- Zweryfikowanie zgodności QSFP-DD lub OSFP dla optyki 400G; patrz przewodnik NVIDIA dotyczący nadajnika Ethernet.

- Wymagana obsługa antystatyczna

Hong Kong Starsurge Group Co., Limitedjest technologicznym dostawcą sprzętu sieciowego, usług IT i rozwiązań integracji systemów.NICStarsurge wspiera branże takie jak rząd, opieka zdrowotna, produkcja,edukacjaFirma oferuje również rozwiązania IoT, systemy zarządzania siecią, niestandardowy rozwój oprogramowania, wsparcie wielojęzyczne i globalną dostawę.Starsurge koncentruje się na niezawodnej jakości, odpowiedzialne usługi i dostosowane rozwiązania, które pomagają klientom budować wydajną, skalowalną i niezawodną infrastrukturę sieciową.

✓ Autoryzowany partner wiodących marek, w tym produktów sieciowych NVIDIA.

| Maksymalna przepustowość | 400 Gb/s (NDR / 400GbE) | PCIe Gen5 | Do 32 pasów |

|---|---|---|---|

| Wsparcie RDMA | InfiniBand & RoCE | Ochrona | IPsec/TLS/MACsec wewnętrzny |

| GPUDirect | RDMA + Przechowywanie | Dokładność czasu | 12ns PTP |

| Składnik | Zalecane / wspierane | Wskazania |

|---|---|---|

| Serwery GPU (HGX/DGX) | Całkowicie kompatybilny z GPUDirect | SHARP rozładowanie na InfiniBand |

| Przełączniki na szczycie regału | NVIDIA QM9700 (NDR), SN4000 (Ethernet) | Wsparcie |

| Hosty wirtualizacji | VMware ESXi 7.0/8.0, KVM, Hyper-V | Włączone SR-IOV |

| Systemy magazynowania | PureStorage, VAST Data, WEKA, Dell PowerScale | NVMe-oF / RoCE gotowe |

| Kable / optyka | NVIDIA pasywny miedziany DAC, aktywny optyczny (400G SR4/DR4) | Potwierdzenie macierzy zgodności |

- Potwierdź, że konfiguracja portu (2-port NDR lub 2x200G) pasuje do planu przełączania.

- Potwierdzenie długości fizycznej gniazda PCIe i typu uchwytu (HHHL / FHHL).

- Sprawdź kierunek przepływu powietrza i wymagania dotyczące pasywnego/aktywnego kabla.

- Zapewnić obsługę sterowników systemu operacyjnego (wersja MLNX_OFED dla jądra).

- W przypadku zabezpieczeń: włączyć bezpieczne uruchamianie i kryptowalutę w systemie.

- Przejrzyj gwarancję i wcześniejsze opcje wymiany.

64-port 400G InfiniBand, integracja SHARPv3.

Kosztowo efektywne 200Gb/s dla mniejszych klastrów.

Akceleracja pamięci masowej i zabezpieczeń + programowalna ścieżka danych.

Zgodne z OSFP do 2xOSFP lub 2xQSFP56.