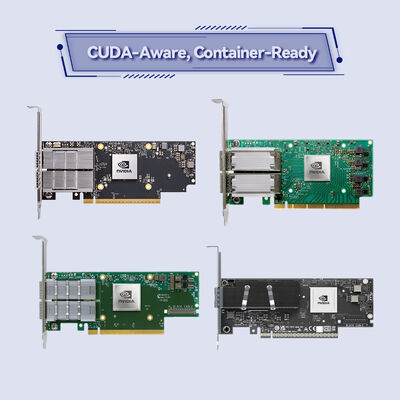

NVIDIA ConnectX-6 MCX653106A-HDAT 200Gb/s Dual-Port InfiniBand Smart Adapter

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX653106A-HDAT-SP |

| Dokument: | connectx-6-infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| stan produktów: | Magazyn | Aplikacja: | Serwer |

|---|---|---|---|

| Stan: | Nowe i oryginalne | Typ: | Przewodowy |

| Maksymalna prędkość: | Do 200 GB/s | Złącze Ethernet: | QSFP56 |

| Model: | MCX653106A-HDAT | Nazwa: | MCX653106A-HDAT-SP Karta sieciowa Mellanox 200 gbe Szybki inteligentny sejf |

| Podkreślić: | NVIDIA ConnectX-6 adapter Infiniband,Karta sieciowa Mellanox 200Gb/s,dwuportowy adapter InfiniBand smart |

||

opis produktu

NVIDIA ConnectX-6 MCX653106A-HDAT

Dwustronny adapter InfiniBand HDR 200 Gb/s

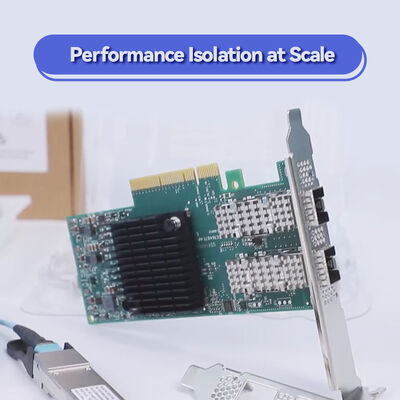

Odblokuj ekstremalną wydajność HPC i AI dzięki technologii NVIDIA In-Network Computing. Ten adapter PCIe 4.0 x16 zapewnia 215 milionów wiadomości na sekundę i sprzętowe przyspieszenie dla najbardziej wymagających centrów danych.

Przegląd produktu

NVIDIA ConnectX-6 MCX653106A-HDAT to dwustronny, inteligentny adapter InfiniBand i Ethernet 200 Gb/s, zaprojektowany jako kamień węgielny platformy NVIDIA Quantum InfiniBand. Integruje zaawansowane funkcje, takie jak Remote Direct Memory Access (RDMA), odciążenia NVMe over Fabrics (NVMe-oF) i szyfrowanie na poziomie blokowym, aby drastycznie zmniejszyć obciążenie procesora. Przenosząc obliczenia do sieci, ten adapter zwiększa skalowalność i wydajność w obliczeniach o wysokiej wydajności, obciążeniach uczenia maszynowego i infrastrukturach chmurowych na dużą skalę.

Kluczowe cechy

- Bardzo wysoka przepustowość: Łączność 200 Gb/s na port z maksymalną łączną przepustowością 200 Gb/s.

- In-Network Computing: Sprzętowe odciążenia dla operacji zbiorczych, dopasowywania tagów MPI i protokołu rendezvous.

- Szyfrowanie na poziomie blokowym: Sprzętowe szyfrowanie XTS-AES 256/512-bitowe dla bezpieczeństwa danych zgodnego z FIPS.

- Obsługa PCIe 4.0: Szybkość połączenia 16 GT/s z pełną kompatybilnością wsteczną z PCIe 3.0/2.0/1.1.

- Częstotliwość komunikatów: Do 215 milionów komunikatów na sekundę dla ekstremalnej wydajności małych pakietów.

- Odciążenia pamięci masowej: Odciążenia docelowe i inicjujące NVMe-oF, T10-DIF i obsługa SRP, iSER, NFS RDMA.

- Wirtualizacja: SR-IOV z maksymalnie 1000 funkcji wirtualnych i ASAP2 dla odciążenia OVS.

Technologia NVIDIA In-Network Computing

ConnectX-6 integruje unikalne silniki In-Network Computing firmy NVIDIA, odciążając operacje komunikacji zbiorczej (takie jak MPI all-reduce) z procesora do sieci. Znacząco zmniejsza to opóźnienia i zwalnia cykle procesora do przetwarzania aplikacji. W połączeniu z RDMA i zaawansowanym mapowaniem pamięci (UMR), adapter umożliwia GPU Direct RDMA i komunikację GPU peer-to-peer przez sieć, przyspieszając klastry treningowe AI i złożone symulacje.

Typowe wdrożenia

- Obliczenia o wysokiej wydajności (HPC): Wielkoskalowe klastry uruchamiające symulacje pogody, dynamikę płynów i dynamikę molekularną.

- AI i uczenie maszynowe: Rozproszone trenowanie głębokich sieci neuronowych wymagające wysokiej przepustowości i niskich opóźnień.

- Centra danych przedsiębiorstw: Docelowe punkty pamięci masowej NVMe-oF, akceleracja baz danych i infrastruktura zwirtualizowana.

- Chmura na dużą skalę: Środowiska wielodostępne wymagające izolacji sprzętowej i QoS.

- Platformy chłodzone cieczą: Kompatybilne z konstrukcjami płyt zimnych Intel Server System D50TNP dla wdrożeń o dużej gęstości.

Kompatybilność

System i procesor: Platformy oparte na x86, Power, Arm, GPU (z GPUDirect) i FPGA.

Przełączniki: W pełni interoperacyjne z przełącznikami NVIDIA Quantum InfiniBand do 200 Gb/s i standardowymi przełącznikami Ethernet.

Kable: Kable miedziane pasywne, optyczne aktywne i DAC ze złączami QSFP56.

Specyfikacje techniczne

| Parametr | Szczegóły |

|---|---|

| Nazwa produktu | NVIDIA ConnectX-6 MCX653106A-HDAT |

| Obsługiwane prędkości | InfiniBand: 200/100/50/40/25/10/1 Gb/s; Ethernet: 200/100/50/40/25/10/1 GbE |

| Porty sieciowe | 2x QSFP56 |

| Interfejs hosta | PCIe Gen 4.0/3.0 x16 (obsługuje również x8, x4, x2, x1) |

| Częstotliwość komunikatów | Do 215 milionów komunikatów/sekundę |

| Funkcje InfiniBand | RDMA, XRC, DCT, ODP, sprzętowa kontrola przeciążenia, 16 milionów kanałów I/O, 8 VL + VL15 |

| Odciążenia Ethernet | RoCE, LSO/LRO, odciążenie sumy kontrolnej, RSS/TSS, odciążenie VXLAN/NVGRE/Geneve |

| Odciążenia pamięci masowej | NVMe-oF (docelowy/inicjujący), T10-DIF, SRP, iSER, SMB Direct |

| Bezpieczeństwo | Sprzętowe szyfrowanie blokowe XTS-AES 256/512-bitowe, zgodne z FIPS |

| Zarządzanie | NC-SI, MCTP przez SMBus/PCIe, PLDM dla Monitora/Firmware, I2C, JTAG |

| Wymiary | 167,65 mm x 68,90 mm (bez wsporników) |

| Regulacje | Zgodność z RoHS, ODCC |

Uwaga: Specyfikacje opierają się na dostępnej dokumentacji. Aby uzyskać pełne szczegóły, prosimy o potwierdzenie przed złożeniem zamówienia.

Przewodnik wyboru: MCX653106A-HDAT

Ten model to dwustronna wariant QSFP56 w formacie PCIe stand-up. Obsługuje zarówno InfiniBand, jak i Ethernet z prędkością do 200 Gb/s. W przypadku potrzeb jednoprzewodowych, rozważ MCX653105A-HDAT. W przypadku formatu OCP 3.0, zapoznaj się z serią MCX653436A-HDAT.

| Porty | Format | OPN | Przypadek użycia |

|---|---|---|---|

| 2x QSFP56 | PCIe Stand-up | MCX653106A-HDAT | Dwustronny 200 Gb/s dla węzłów HPC/AI o wysokiej dostępności |

| 1x QSFP56 | PCIe Stand-up | MCX653105A-HDAT | Jednostronny 200 Gb/s dla standardowych obliczeń |

| 2x QSFP56 | Socket Direct | MCX654106A-HCAT | Optymalizacja serwerów wielogniazdowych |

Zalety ConnectX-6 MCX653106A-HDAT

- Przyszłościowe I/O: Gotowość PCIe 4.0 zapewnia przepustowość dla procesorów i kart graficznych nowej generacji.

- Bezpieczeństwo domyślnie: Wbudowane szyfrowanie zgodne z FIPS eliminuje potrzebę stosowania samoczynnie szyfrujących dysków.

- Konsolidacja infrastruktury: Jeden adapter obsługuje zarówno InfiniBand, jak i Ethernet, upraszczając inwentaryzację.

- Skalowalne przechowywanie danych: Pełne odciążenia NVMe-oF zmniejszają obciążenie procesora w zdecentralizowanych architekturach pamięci masowej.

Serwis i wsparcie

Wspierani przez doświadczony zespół techniczny Hong Kong Starsurge Group, zapewniamy:

- Pomoc w konfiguracji przed sprzedażą dla Twojego specyficznego środowiska HPC lub przedsiębiorstwa.

- Globalna wysyłka z możliwością śledzenia i bezpiecznym pakowaniem.

- Wsparcie w aktualizacji oprogramowania układowego i pobieraniu sterowników.

- Usługi gwarancyjne i RMA (warunki mogą się różnić w zależności od regionu).

Najczęściej zadawane pytania

P: Czy ta karta jest kompatybilna ze standardowymi przełącznikami Ethernet?

O: Tak, MCX653106A-HDAT obsługuje zarówno InfiniBand, jak i Ethernet. Może działać z prędkością 200/100/50/40/25/10/1 GbE.

P: Czy obsługuje NVIDIA GPUDirect?

O: Absolutnie. Obsługuje GPUDirect RDMA i PeerDirect do bezpośredniej komunikacji GPU-GPU przez sieć.

P: Jaka jest różnica między MCX653106A-HDAT a MCX653106A-ECAT?

O: Sufiks -HDAT oznacza wariant o wysokiej prędkości obsługujący 200 Gb/s, podczas gdy -ECAT zazwyczaj oznacza wersję o niższej prędkości (100 Gb/s). Zawsze sprawdzaj w przewodniku zamówień.

P: Czy mogę używać tej karty w gnieździe PCIe Gen 3?

O: Tak, jest ona wstecznie kompatybilna z PCIe Gen 3.0, ale przepustowość będzie ograniczona do około 100 Gb/s na port z powodu wolniejszej magistrali.

Środki ostrożności podczas instalacji

- Zapewnij odpowiedni przepływ powietrza; adapter może wymagać aktywnego chłodzenia w gęstych środowiskach.

- Używaj tylko modułów i kabli QSFP56 zatwierdzonych do pracy z prędkością 200 Gb/s, aby uniknąć niestabilności połączenia.

- Sprawdź obsługę podziału gniazd PCIe na płycie głównej, jeśli używasz wariantu Socket Direct.

- Potwierdź budżet mocy: karta pobiera zasilanie z gniazda PCIe; moduły optyczne o dużej mocy mogą wymagać dodatkowego rozważenia zasilania.

O firmie Hong Kong Starsurge Group Co., Limited

Założona w 2008 roku, Hong Kong Starsurge Group jest dostawcą sprzętu sieciowego, usług IT i rozwiązań integracji systemów opartych na technologii. Obsługujemy klientów na całym świecie, oferując produkty takie jak przełączniki sieciowe, karty sieciowe, punkty dostępu bezprzewodowego, kontrolery i powiązany sprzęt sieciowy. Nasz doświadczony zespół sprzedaży i techniczny wspiera branże takie jak administracja publiczna, opieka zdrowotna, produkcja, edukacja, finanse i przedsiębiorstwa. Dzięki podejściu stawiającemu klienta na pierwszym miejscu, Starsurge koncentruje się na niezawodnej jakości, responsywnej obsłudze i dopasowanych rozwiązaniach, które pomagają klientom budować wydajną, skalowalną i niezawodną infrastrukturę sieciową. Oferujemy rozwiązania IoT, systemy zarządzania siecią, niestandardowe tworzenie oprogramowania, wsparcie wielojęzyczne i globalną dostawę.

Kluczowe fakty w skrócie

Macierz kompatybilności

| Komponent | Obsługiwany? | Uwagi |

|---|---|---|

| Przełączniki NVIDIA Quantum | Tak | Pełna interoperacyjność HDR 200 Gb/s |

| Płyty główne PCIe Gen 4.0 | Tak | Pełna prędkość linii 200 Gb/s |

| Płyty główne PCIe Gen 3.0 | Tak | Ograniczona do ~100 Gb/s na port |

| VMware vSphere | Tak | Dostępne sterowniki |

| Intel D50TNP chłodzony cieczą | Specjalny SKU | Dostępna wersja z płytą zimną; potwierdź OPN |

Lista kontrolna kupującego

- Potwierdź, że serwer ma wolne gniazdo PCIe 4.0 x16 (fizyczne i elektryczne).

- Zweryfikuj prędkość sieci InfiniBand: ta karta jest zdolna do HDR (200 Gb/s).

- Wybierz odpowiednie moduły QSFP56 (SR, LR lub DAC) dla swojej odległości.

- Upewnij się, że zasilanie i chłodzenie są wystarczające do pracy z dużą prędkością.

- Sprawdź obsługę systemu operacyjnego/sterowników: RHEL, Ubuntu, Windows Server itp.