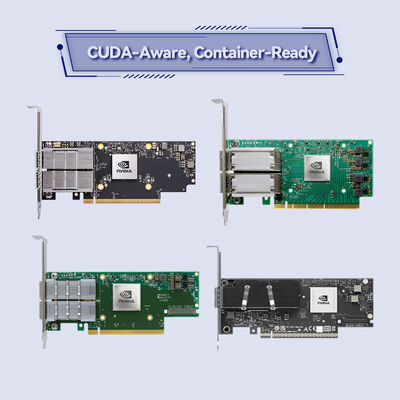

Karta sieciowa NVIDIA MCX555A-ECAT 100 Gb/s z pojedynczym portem QSFP28 InfiniBand PCIe 3.0 x16 ConnectX-5

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX555A-ECAT |

| Dokument: | CONNECTX-5 infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| stan produktów: | Magazyn | Aplikacja: | Serwer |

|---|---|---|---|

| Stan: | Nowe i oryginalne | Typ: | Przewodowy |

| Maksymalna prędkość: | EDR i 100 GBE | Złącze Ethernet: | QSFP28 |

| Podkreślić: | Karta sieciowa NVIDIA ConnectX-5 InfiniBand,Karta sieciowa 100 Gb/s QSFP28,Karta Mellanox PCIe 3.0 x16 |

||

opis produktu

Wysokiej wydajności, niskiego opóźnienia 100Gb / s adapter sieciowy zaprojektowany do HPC, AI i chmury centrów danych.i dopasowywanie tagów do obciążeń roboczych MPI, zapewniając wiodącą w branży przepustowość i wydajność procesora.

W sprawieNVIDIA ConnectX-5 MCX555A-ECATjest jednoportową kartą adaptera InfiniBand o prędkości 100 Gb/s w niskim formie PCIe.Przepustowość 100 Gb/sKarta obsługuje zarówno InfiniBand (do EDR) jak i 100GbE, zapewniając wszechstronną łączność dla obliczeń o wysokiej wydajności, pamięci masowej,i środowisk wirtualizowanych.

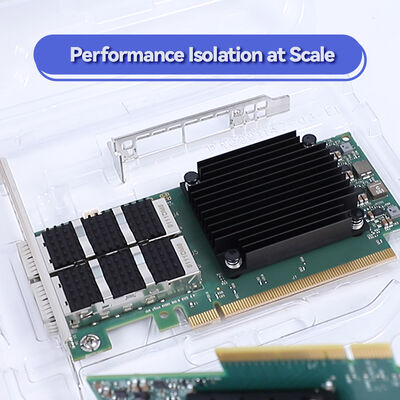

Zbudowany z wbudowanym przełącznikiem PCIe i zaawansowanymi możliwościami RDMA, MCX555A-ECAT odbiera krytyczne zadania komunikacyjne od procesora mniejsze zużycie energiiJest w pełni kompatybilny ze slotami PCIe 3.0 x16 i obsługuje szeroki zakres systemów operacyjnych i ram akceleracyjnych.

- Do 100 Gb/słączność na port (InfiniBand EDR / 100GbE)

- Jednorazowy złącze QSFP28do kabli optycznych lub miedzianych

- Interfejs PCIe 3.0 x16(automatycznie negocjuje x8, x4, x2, x1)

- RDMA, semantyka wysyłania/odbieraniaz niezawodnym transportem opartym na sprzęcie

- Zastosowanie etykiet i miejsce spotkania wyładunkudla MPI i SHMEM

- NVMe w tkaninach (NVMe-oF)do skutecznego przechowywania

- GPUDirect (PeerDirect)przyspieszenie dla komunikacji GPU

- Oprogramowanie do sterowania zatłoczeniami i wsparcie adaptacyjnego routingu

- Wirtualizacja SR-IOV:do 512 wirtualnych funkcji

- Zgodny z RoHS, nisko profilowy czynnik formy(włącznie z uchwytami)

Architektura ConnectX-5 integruje szereg silników przyspieszenia sprzętu, które zmniejszają interwencję procesora i poprawiają skalowalność aplikacji:

- MPI Tag Matching & Rendezvous Offload:Obciążenie zestawiania wiadomości i przetwarzania protokołu rendezvous, radykalnie poprawiając wydajność MPI dla klastrów HPC.

- RDMA w stanie awaryjnym z adaptywnym sterowaniem:Umożliwia efektywne wykorzystanie wielu ścieżek sieciowych przy jednoczesnym zachowaniu uporządkowanej semantyki zakończenia, maksymalizując wykorzystanie tkaniny.

- NVMe-oF Cel wyładowania:Umożliwia systemom pamięci masowej NVMe obsługę zdalnego dostępu z niemal zerowymi kosztami CPU, co jest idealne dla architektur pamięci masowej.

- Dynamicznie połączony transport (DCT):Zapewnia ekstremalną skalowalność dla dużych systemów obliczeniowych i pamięci masowej poprzez wyeliminowanie kosztów konfiguracji połączeń.

- ASAP2 przyspieszone przełączanie i przetwarzanie pakietów:Wykorzystanie sprzętu sprzętowego do Open vSwitch (OVS) i tworzenia tuneli sieciowych (VXLAN, NVGRE, GENEVE).

- Wyświetlanie stron na żądanie (ODP):Wspiera wyszukiwanie wirtualnej pamięci dla operacji RDMA, uproszczając rozwój aplikacji.

- Wykorzystanie urządzeń do obliczeń o wysokiej wydajności (HPC):Idealny do klastrów superkomputerów, symulacji opartych na MPI i obciążeń naukowych wymagających niskiej opóźnienia i wysokich częstotliwości przesyłania wiadomości.

- Szkolenie w zakresie sztucznej inteligencji i głębokiego uczenia się:W połączeniu z GPUDirect RDMA umożliwia szybką komunikację GPU-to-GPU między węzłami, przyspieszając czas szkolenia.

- Systemy magazynowania NVMe-oF:Wdrożenie jako cele lub inicjatory pamięci masowej w środowiskach NVMe over Fabrics w celu uzyskania dostępu do pamięci masowej o wysokiej przepustowości i niskim opóźnieniu.

- Chmura i wirtualizowane centra danychSR-IOV i wyładowania wirtualizacyjne obsługują środowiska z wieloma najemcami z gwarantowaną jakością obsługi i bezpieczną izolacją.

- Handel wysokiej częstotliwości (HFT):Ultra niskie opóźnienie i oznaczanie czasu sprzętowe (IEEE 1588v2) spełniają wymagania aplikacji usług finansowych.

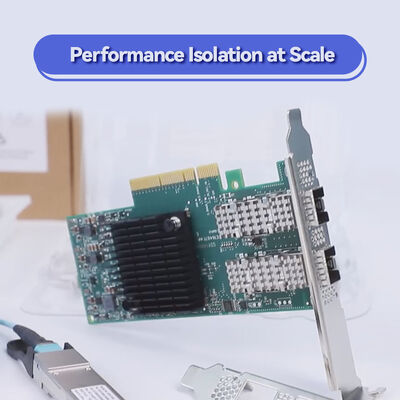

MCX555A-ECAT został zaprojektowany z myślą o szerokiej kompatybilności z przełącznikami NVIDIA InfiniBand (np. Quantum, Spectrum) i zewnętrznymi przełącznikami 100GbE.Wspiera zarówno pasywne miedziane DAC, jak i aktywne kable optyczne za pośrednictwem portów QSFP28.

Systemy operacyjne i stosy oprogramowania:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, MPI platformy

- Zestaw rozwoju płaszczyzny danych (DPDK) do obejścia jądra

| Parametry | Specyfikacja |

|---|---|

| Model | MCX555A-ECAT |

| Wskaźnik kształtu | PCIe Low-Profile (14,2 cm x 6,9 cm bez uchwytu), wysoki uchwyt wstępnie zainstalowany, krótki uchwyt wliczony |

| Prędkość i typ portu | 1x QSFP28, do 100Gb/s InfiniBand (EDR) i 100GbE |

| Interfejs hosta | PCI Express 3.0 x16 (kompatybilny z x8, x4, x2, x1) |

| Wsparcie InfiniBand | zgodny z IBTA 1.3, 100Gb/s EDR, FDR, QDR, DDR, SDR; 8 wirtualnych pasów + VL15; 16 milionów kanałów I/O |

| Wsparcie Ethernet | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Zdolności RDMA | RDMA przez konwergencyjny Ethernet (RoCE), niezawodny transport sprzętowy, RDMA poza porządkiem, operacje atomowe |

| Wypływy z magazynu | NVMe over Fabrics, iSER, SRP, NFS RDMA, SMB Direct, przekazanie podpisu T10 DIF |

| Wirtualizacja | SR-IOV (do 512 funkcji wirtualnych), VMware NetQueue, NPAR, PCIe Access Control Services (ACS) |

| Wyładowanie procesora | TCP/UDP/IP stateless offload, LSO/LRO, checksum offload, RSS/TSS, VLAN/MPLS tag insertion/stripping |

| Sieci nakładane | Wykorzystanie sprzętu sprzętowego do wkapsułowania/odkapsułowania VXLAN, NVGRE, GENEVE |

| Zarządzanie | NC-SI przez MCTP, PLDM do monitorowania/kontroli i aktualizacji oprogramowania, I2C, SPI, JTAG |

| Wyrzucić urządzenie | Wypalanie zdalne przez InfiniBand, Ethernet, iSCSI; wsparcie UEFI, PXE |

| Zużycie energii | Nie jest publicznie określony; typowy zakres poniżej 20 W. Proszę potwierdzić dla systemu |

| Temperatura pracy | 0°C do 55°C (typowe środowisko) |

| Zgodność | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Uwaga: Specyfikacje pochodzą z dokumentacji produktu NVIDIA ConnectX-5.

| Numer części zamówionej | Porty / Prędkość | Interfejs hosta | Wskaźnik kształtu | Kluczowe cechy |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe o niskim profilu | Standardowy pojedynczy port, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe o niskim profilu | Dwu-port, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100Gb/s | PCIe 4.0 x16 | PCIe o niskim profilu | ConnectX-5 Ex, ulepszony PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Podłączenie serwera z dwoma gniazdami za pomocą podłącza |

| MCX545B-ECAN | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | OCP 2.0 typ 1 | Open Compute Project |

Wszystkie karty obsługują kompatybilność wsteczną do niższych prędkości.

- Wyższa wydajność aplikacji:Oprogramowanie odpowiada za MPI, NVMe-oF i nakłada wolne rdzenie procesora do logiki biznesowej.

- Wskazalna tkanina RDMA:DCT, XRC i RDMA poza porządkiem zapewniają liniową skalowalność dla tysięcy węzłów.

- Przygotowanie przyspieszenia GPU:GPUDirect RDMA umożliwia bezpośredni dostęp do pamięci między procesorami graficznymi a adapterami sieciowymi, eliminując wąskie gardła procesora w klastrach sztucznej inteligencji.

- Elastyczny rozmieszczenie:Jeden port QSFP28 upraszcza okablowanie i jest idealny dla architektury leaf-spine o prędkości 100 Gb/s.

- Ochrona inwestycji:Wsparcie zarówno dla InfiniBand, jak i Ethernet umożliwia płynne przejście między protokołami w miarę ewolucji potrzeb.

Hong Kong Starsurge Group zapewnia pełne wsparcie cyklu życia dla adapterów NVIDIA ConnectX-5, w tym pomoc w konfiguracji przedsprzedażowej, wskazówki dotyczące aktualizacji oprogramowania układowego i usług gwarancyjnych.Nasz zespół techniczny może pomóc:

- Weryfikacja zgodności z infrastrukturą serwera i przełącznika

- Tuneingowanie wydajności dla obciążeń roboczych HPC lub pamięci masowej

- Opcje opakowań na zamówienie i wymagania dotyczące opakowań masowych

- Usługi przetwarzania RMA i zaawansowane usługi wymiany

Skontaktuj się z naszymi inżynierami sprzedaży, aby uzyskać informacje na temat cen i czasu realizacji.

Rozładowanie elektrostatyczne (ESD):Zawsze stosuj bezpieczne metody ESD podczas obsługi adaptera.Wymogi dotyczące chłodzenia:Zapewnienie odpowiedniego przepływu powietrza w podwoziu serwera w celu utrzymania temperatury roboczej w określonym zakresie.Aktualizacje oprogramowania:Użyj oficjalnych narzędzi oprogramowania stałego NVIDIA (MFT) i sprawdź zgodność z wersją systemu operacyjnego i sterownika przed aktualizacją.Zgięcie kable:W celu uniknięcia degradacji sygnału należy przestrzegać wytycznych dotyczących promienia zakrętu kabla QSFP28.

To produkt klasy A. W środowisku mieszkalnym może powodować zakłócenia radiowe.

Założona w 2008 roku,Hong Kong Starsurge Group Co., Limitedjest technologicznym dostawcą sprzętu sieciowego, usług informatycznych i rozwiązań integracji systemów.kontrolerówStarsurge łączy głęboką wiedzę techniczną z podejściem zorientowanym na klienta.,i przedsiębiorstwa, oferując rozwiązania IoT, systemy zarządzania siecią, niestandardowe opracowywanie oprogramowania i wielojęzyczną globalną dostawę.Starsurge pomaga klientom budować efektywne, skalowalna i niezawodna infrastruktura sieciowa.

| Składnik / system | Status zgodności | Uwaga: |

|---|---|---|

| NVIDIA Quantum InfiniBand Switches | Certyfikat | Kompatybilność EDR, HDR przy stosowaniu odpowiedniego oprogramowania |

| Przełączniki NVIDIA Spectrum Ethernet | Certyfikat | Wspierane tryby 100GbE, 50GbE, 25GbE |

| Komutatory 100GbE zewnętrzne | Kompatybilne | Wymaga zgodności ze standardami IEEE; przetestowane u głównych dostawców |

| Serwery GPU (NVIDIA DGX, HGX) | Certyfikat GPUDirect | Przyspieszenie RDMA dla komunikacji wielo-GPU |

| Zestawy pamięci masowej z NVMe-oF | Wsparcie | Cel obciążenia umożliwia efektywny dostęp do tkaniny NVMe |

- Potwierdź, że serwer ma dostępny gniazdo PCIe 3.0 x16 (lub x8) z odpowiednim wolnym miejscem.

- W przypadku, gdy wprowadzone są dodatkowe informacje, należy określić, czy wprowadzone są dodatkowe informacje, o których mowa w ust. 1.

- Wybór typu kabla: pasywny DAC miedziany dla krótkich odległości (≤ 5 m) lub optyczny dla dłuższych przebiegów.

- W celu zapewnienia odpowiedniej obsługi systemu operacyjnego i sterowników (OFED, Windows, VMware).

- W przypadku klastrów GPU, upewnij się, że GPUDirect RDMA jest kompatybilny z modelem GPU i wersją sterownika.

- Sprawdź, czy na podwoziu serwera wymagane jest wysokie lub krótkie uchwyty.

- NVIDIA MCX556A-ECAT

- NVIDIA MCX556A-EDAT ️ ConnectX-5 Ex z obsługą PCIe 4.0

- NVIDIA Quantum-2 QM9700 40-port 800Gb/s InfiniBand Switch

- Kable DAC pasywne Mellanox QSFP28 (1m, 2m, 3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE przełączniki Ethernet

- Podręcznik użytkownika karty NVIDIA ConnectX-5 InfiniBand Adapter

- RDMA przez konwergencyjny Ethernet (RoCE)

- GPUDirect RDMA Najlepsze praktyki dla klastrów sztucznej inteligencji

- NVMe nad tkaninami z ConnectX-5

- Przewodnik ds. instalacji i dostrojenia OFED