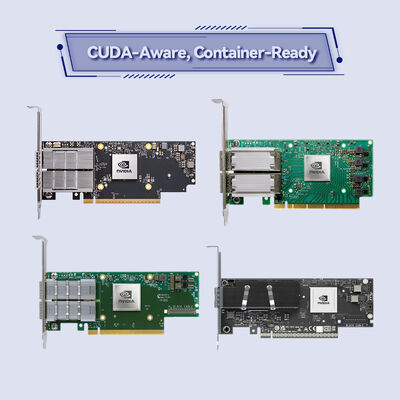

NVIDIA ConnectX-6 InfiniBand Adapter MCX653106A-ECAT 200Gb/s Smart NIC

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX653106A-ECAT |

| Dokument: | connectx-6-infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| stan produktów: | Magazyn | Aplikacja: | Serwer |

|---|---|---|---|

| Typ interfejsu:: | Infiniband | Porty: | Podwójny |

| Maksymalna prędkość: | 100 gbe | Typ: | Przewodowy |

| Stan: | Nowe i oryginalne | Czas gwarancji: | 1 rok |

| Model: | MCX653106A-ECAT | Nazwa: | Karta sieciowa Mellanox Oryginalna karta sieciowa MCX653106A-ECAT connect X-6 100 Gb/s dwuportowa ka |

| Słowo kluczowe: | Karta sieciowa Mellanox | ||

| Podkreślić: | NVIDIA ConnectX-6 adapter Infiniband,Inteligentny NIC 200Gb/s,Karta sieciowa Mellanox z gwarancją |

||

opis produktu

Dwustronna inteligentna karta sieciowa 200 Gb/s z przetwarzaniem w sieci

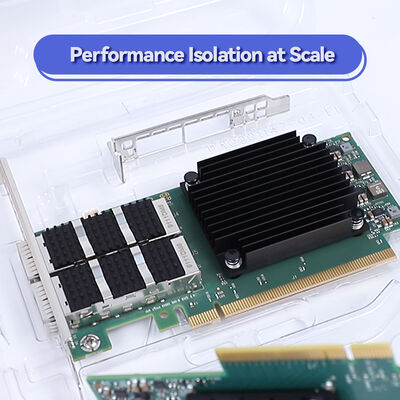

NVIDIA ConnectX-6 MCX653106A-ECAT zapewnia przepustowość doPCIe 3.0/4.0 x16opóźnienia poniżej mikrosekundy i sprzętowe odciążenia dla HPC, AI i hiperkonwergentnych pamięci masowych. Wyposażona w RDMA, akcelerację NVMe-oF, szyfrowanie XTS-AES na poziomie blokowym i PCIe 4.0, ta dwustronna karta InfiniBand QSFP56 maksymalizuje wydajność i skalowalność centrum danych. Idealna dla klastrów GPU, trenowania ML i krytycznych sieci.

Model2x QSFP56jest częścią rodziny kart sieciowych NVIDIA ConnectX-6 InfiniBand, zaprojektowanych do najbardziej wymagających obciążeń. Łączy dwa porty QSFP56 zdolne do połączeń InfiniBand 200 Gb/s lub Ethernet 200 Gb/s, oferując sprzętowe niezawodne przesyłanie, kontrolę przeciążenia i silniki przetwarzania w sieci. Odciążając operacje zbiorcze, dopasowywanie tagów MPI i szyfrowanie z procesora hosta, karta zmniejsza obciążenie procesora i zwiększa wydajność aplikacji w dużych klastrach. Przedsiębiorstwa, laboratoria badawcze i centra danych o skali hiperskalowalnej polegają na ConnectX-6 w celu budowy energooszczędnych sieci o niskim opóźnieniu.

Do 200 Gb/s na port (HDR InfiniBand / 200GbE)

Do 215 milionów komunikatów/sekundę

Poziom blokowy XTS-AES 256/512-bit, zgodne z FIPS

Odciążenia zbiorcze, odciążenia celu/inicjatora NVMe-oF

PCIe Gen 4.0/3.0 x16 (obsługa dwustronna)

SR-IOV do 1K VF, ASAP2, odciążenie Open vSwitch

Obsługa RoCE, XRC, DCT, stronicowania na żądanie, routingu adaptacyjnego

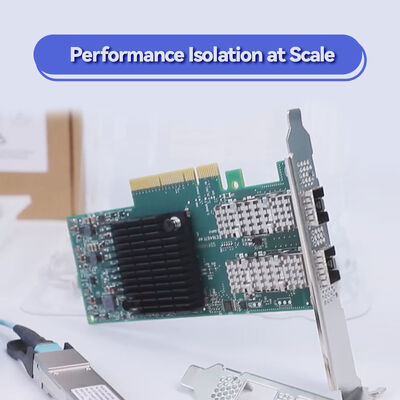

PCIe typu stand-up (niski profil), dwustronny QSFP56

Zbudowany na sprawdzonej architekturze InfiniBand firmy NVIDIA, ConnectX-6 integrujePrzetwarzanie w sieciw celu przyspieszenia operacji MPI, frameworków uczenia głębokiego i protokołów pamięci masowej. Karta obsługujeZdalny dostęp do pamięci (RDMA)dla transferów danych bez kopiowania, omijając procesor i jądro. Sprzętowa kontrola przeciążenia zapewnia przewidywalną wydajność nawet przy dużym obciążeniu. Dodatkowo,NVIDIA GPUDirect RDMAumożliwia bezpośrednią wymianę danych między pamięcią GPU a kartą sieciową, znacznie zmniejszając opóźnienia w trenowaniu AI. Dzięki obsłudzeodciążeń NVMe over Fabrics (NVMe-oF)karta zmniejsza wykorzystanie procesora w macierzach pamięci masowej, jednocześnie umożliwiając szybki dostęp do pamięci flash NVMe o niskim opóźnieniu.

- Obliczenia o wysokiej wydajności (HPC):Duże symulacje, modelowanie pogody i obliczeniowa dynamika płynów wymagające niskiego opóźnienia i wysokiej przepustowości.

- Klastry AI i uczenia maszynowego:Rozproszone trenowanie głębokich sieci neuronowych, wykorzystujące GPUDirect i RDMA dla maksymalnej wydajności.

- Systemy pamięci masowej NVMe-oF:Odciążenia celu lub inicjatora umożliwiają wysokowydajne, rozproszone pamięci masowe przy niskim obciążeniu procesora.

- Centra danych o skali hiperskalowalnej:Środowiska zwirtualizowane z SR-IOV, sieciami nakładkowymi i łańcuchami usług.

- Usługi finansowe:Infrastruktura handlowa o bardzo niskim opóźnieniu wymagająca deterministycznej wydajności.

MCX653106A-ECAT jest kompatybilna z szeroką gamą serwerów, przełączników i systemów operacyjnych. Współpracuje z przełącznikami NVIDIA Quantum InfiniBand (HDR 200 Gb/s), a także z przełącznikami Ethernet 200 GbE. Karta obsługuje standardowe gniazda PCIe (x16, x8, x4) i zawiera wsparcie sterowników dla głównych platform systemów operacyjnych.

| Parametr | Specyfikacja |

|---|---|

| Model produktu | 2x QSFP56 |

| Szybkość transmisji danych | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand i Ethernet) |

| Maksymalna prędkość | 2x złącza QSFP56 |

| Kluczowy wyróżnik | PCIe Gen 4.0 / 3.0 x16 (obsługuje konfiguracje x8, x4, x2, x1) |

| Opóźnienie | Niezwykle niskie poniżej mikrosekundy (typowe <0,8 µs)Częstotliwość komunikatów |

| Do 215 milionów komunikatów/sekundę | Szyfrowanie |

| XTS-AES 256/512-bit, gotowość do zgodności z FIPS 140-2 | Format |

| PCIe niskoprofilowy typu stand-up (zamontowany z wysokim wspornikiem, krótki wspornik w zestawie) | Wymiary (bez wspornika) |

| 167,65 mm x 68,90 mm | Pobór mocy |

| Typowo 22 W (w zależności od ruchu) | Wirtualizacja |

| SR-IOV (1K VF), VMware NetQueue, NPAR, odciążenie przepływu ASAP2 | Zarządzanie |

| NC-SI, MCTP przez PCIe/SMBus, PLDM do aktualizacji i monitorowania oprogramowania układowego | Zdalne uruchamianie |

| InfiniBand, iSCSI, PXE, UEFI | Systemy operacyjne |

| RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, stos OFED | Przewodnik wyboru – karty ConnectX-6 |

| Porty | Maksymalna prędkość | Interfejs hosta | Kluczowy wyróżnik | MCX653106A-ECAT |

|---|---|---|---|---|

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwustronny | MCX653105A-HDAT |

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwustronny | MCX653106A-HDAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwustronny | MCX653105A-ECAT |

| 1x QSFP56 | 100 Gb/s | PCIe x16 | Jednostronne 100 Gb/s, niższy koszt wejścia | MCX653436A-HDAT (OCP 3.0) |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwustronny | Uwaga: Nie wszystkie funkcje (np. silnik szyfrowania) są dostępne w każdym OPN. MCX653106A-ECAT skupia się na dwustronnej wydajności 100 Gb/s z pełnym zestawem funkcji ConnectX-6, w tym RDMA, odciążeniami pamięci masowej i wirtualizacją. Dla dwustronnych 200 Gb/s rozważ warianty -HDAT. Przed złożeniem zamówienia potwierdź wymagania dotyczące szyfrowania. |

- Sprzętowe odciążenia dla MPI, NVMe-oF i szyfrowania zwalniają rdzenie procesora dla rzeczywistych obciążeń.Przyszłościowa przepustowość:

- PCIe 4.0 i gotowość 200 Gb/s zapewniają długowieczność w szybkich sieciach.Pamięć i przetwarzanie w sieci:

- Obsługuje odciążenia zbiorcze i buforowanie impulsów, zmniejszając narzut związany z ruchem danych.Zaufane bezpieczeństwo:

- Szyfrowanie AES-XTS na poziomie blokowym z zgodnością FIPS zapewnia ochronę danych w spoczynku i w tranzycie bez utraty wydajności.Uproszczone zarządzanie:

- Szerokie wsparcie systemów operacyjnych i hipernadzorców, z ujednoliconym stosem sterowników (OFED, WinOF-2).Serwis i wsparcie

Najczęściej zadawane pytania

Od 2008 roku Hong Kong Starsurge Group Co., Limited dostarcza światowej klasy sprzęt sieciowy klasy korporacyjnej, integrację systemów i usługi IT na całym świecie. Jako zaufany partner produktów sieciowych NVIDIA, Starsurge oferuje certyfikowane rozwiązania dla centrów danych rządowych, finansowych, medycznych, edukacyjnych i o skali hiperskalowalnej. Nasz zespół techniczny zapewnia płynne wdrożenie, od projektowania architektury przed sprzedażą po wsparcie po sprzedaży. Dzięki filozofii stawiającej klienta na pierwszym miejscu, dostarczamy dopasowane, skalowalne komponenty infrastruktury, w tym karty sieciowe, przełączniki, kable i kompleksowe rozwiązania sieciowe.

Kluczowe fakty w skrócie

2 porty 100 Gb/s

| Uwagi | Przełączniki NVIDIA Quantum HDR | ✓ Tak |

|---|---|---|

| Pełna integracja sieci 200 Gb/s | Kernel Linux i OFED | ✓ Tak |

| Wymaga kompatybilnych transceiverów/trybów FEC | Kernel Linux i OFED | ✓ Tak |

| Obsługiwane serie GPU NVIDIA | Kernel Linux i OFED | ✓ Certyfikowany |

| Natywne sterowniki, obsługa SR-IOV | Windows Server 2019/2022 | ✓ Tak |

| Pakiet sterowników WinOF-2 | Kernel Linux i OFED | ✓ Pełne wsparcie |

| MLNX_OFED, sterowniki wbudowane | Lista kontrolna kupującego – przed złożeniem zamówienia | Potwierdź wymaganą prędkość łącza: czy dwustronne 100 Gb/s pasuje do planu przepustowości klastra? Dla dwustronnych 200 Gb/s rozważ OPN -HDAT. |

- Sprawdź typ kabla: pasywne miedziane QSFP56 (do 5 m) lub aktywne kable optyczne dla większego zasięgu.

- Upewnij się, że dostępne są sterowniki systemu operacyjnego (OFED, WinOF).

- W przypadku wymagań dotyczących szyfrowania: potwierdź, czy potrzebne jest wbudowane szyfrowanie blokowe – MCX653106A-ECAT obsługuje AES-XTS, ale zawsze potwierdź poziom FIPS w arkuszu danych NVIDIA.

- Oceń potrzeby wirtualizacji: SR-IOV, odciążenie VXLAN itp.