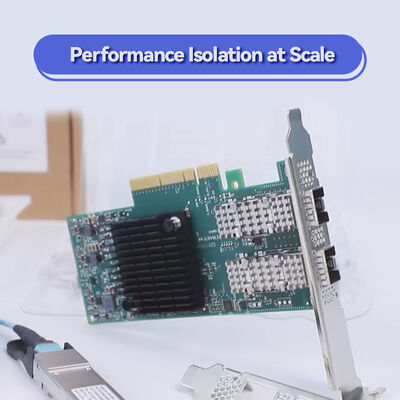

NVIDIA ConnectX-6 MCX653105A-HDAT 200Gb/s Single-Port InfiniBand Smart Adapter z szyfrowaniem sprzętowym i PCIe 4.0

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX653105A-HDAT |

| Dokument: | connectx-6-infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| stan produktów: | Magazyn | Aplikacja: | Serwer |

|---|---|---|---|

| Stan: | Nowe i oryginalne | Typ: | Przewodowy |

| Maksymalna prędkość: | Do 200 GB/s | Złącze Ethernet: | QSFP56 |

| Model: | MCX653105A-HDAT | ||

| Podkreślić: | NVIDIA ConnectX-6 adapter Infiniband,Karta sieciowa PCIe 4.0 o prędkości 200 Gb/s,Adapter InfiniBand z szyfrowaniem sprzętowym |

||

opis produktu

Jednoportowa karta HDR 200 Gb/s z funkcjami In-Network Computing i szyfrowaniem sprzętowym

Karta NVIDIA ConnectX-6 1x QSFP56 zapewnia pełną przepustowość 200 Gb/s na jednym porcie QSFP56, łącząc bardzo niskie opóźnienia, odciążenia sprzętowe i szyfrowanie blokowe XTS-AES. Zaprojektowana dla klastrów HPC, AI i pamięci masowej NVMe-oF, ta karta PCIe 4.0 x16 odciąża operacje zbiorcze, RDMA i szyfrowanie od procesora, maksymalizując wydajność aplikacji i skalowalność w wymagających środowiskach centrów danych.

Karta 1x QSFP56 należy do rodziny kart sieciowych NVIDIA ConnectX-6 InfiniBand, zaprojektowanych z myślą o ekstremalnej wydajności w nowoczesnych centrach danych. Ta jednoportowa karta QSFP56 obsługuje prędkość do PCIe 3.0/4.0 x16 (HDR InfiniBand lub 200 GbE) z pełnym akceleratorem sprzętowym dla RDMA, niezawodnego transportu i In-Network Computing. Dzięki integracji odciążeń operacji zbiorczych, dopasowywania tagów MPI i akceleracji NVMe over Fabrics, karta znacznie zmniejsza obciążenie procesora, jednocześnie zwiększając wydajność sieci. Wbudowane szyfrowanie blokowe AES-XTS zapewnia bezpieczeństwo danych bez utraty wydajności, co czyni ją idealną dla usług finansowych, badań rządowych i wdrożeń w chmurach hiperskalowalnych.

Do 200 Gb/s (HDR InfiniBand / 200 GbE) na pojedynczym QSFP56

Do 215 milionów komunikatów/sekundę

Blokowe XTS-AES 256/512-bitowe, zgodne z FIPS

Odciążenia zbiorcze, odciążenia celu/inicjatora NVMe-oF, bufor impulsowy

PCIe Gen 4.0 / 3.0 x16 (kompatybilność wsteczna)

SR-IOV (1K VFs), ASAP2, odciążenie Open vSwitch, tunele nakładkowe

RoCE, XRC, DCT, stronicowanie na żądanie, obsługa GPUDirect RDMA

Pionowa karta PCIe niskoprofilowa, zainstalowany wspornik wysoki + dołączony wspornik krótki

NVIDIA ConnectX-6 integruje silniki akcelerujące In-Network Computing które odciążają krytyczne operacje centrum danych od procesora hosta. Karta MCX653105A-HDAT obsługuje niezawodny transport oparty na sprzęcie, adaptacyjne routowanie i kontrolę przeciążeń, zapewniając przewidywalną wydajność w sieciach na dużą skalę. Remote Direct Memory Access (RDMA) umożliwia transfery danych bez kopiowania, omijając jądro systemu operacyjnego. Dzięki NVIDIA GPUDirect RDMA, pamięć GPU komunikuje się bezpośrednio z kartą sieciową, znacznie zmniejszając opóźnienia w treningu AI i symulacjach HPC. Wbudowane szyfrowanie blokowe XTS-AES (klucz 256/512-bitowy) zapewnia bezpieczeństwo danych w tranzycie i w spoczynku bez obciążenia procesora, a karta jest zaprojektowana tak, aby spełniać wymagania zgodności z FIPS 140-2.

- Obliczenia o wysokiej wydajności (HPC): Symulacje na dużą skalę, prognozowanie pogody i dynamika płynów obliczeniowych wymagające niskolatencyjnego połączenia 200 Gb/s.

- Klastry AI i uczenia głębokiego: Rozproszony trening z GPUDirect RDMA, maksymalizujący przepustowość między węzłami GPU.

- Systemy pamięci masowej NVMe-oF: Wysokowydajna rozproszona pamięć masowa z pełnymi odciążeniami celu/inicjatora, zmniejszająca wykorzystanie procesora.

- Centra danych hiperskalowalnych i chmurowych: Środowiska zwirtualizowane z SR-IOV, sieciami nakładkowymi i szyfrowaniem akcelerowanym sprzętowo.

- Platformy handlu finansowego: Niskolatencyjne, deterministyczne sieci dla handlu algorytmicznego.

Karta ConnectX-6 MCX653105A-HDAT współpracuje bezproblemowo ze przełącznikami NVIDIA Quantum InfiniBand (HDR 200 Gb/s), standardowymi przełącznikami 200 GbE i szeroką gamą platform serwerowych. Obsługuje główne systemy operacyjne i stosy wirtualizacji, zapewniając elastyczną integrację z istniejącą infrastrukturą.

| Parametr | Specyfikacja |

|---|---|

| Model produktu | 1x QSFP56 |

| Szybkość transmisji danych | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand i Ethernet) |

| Porty i złącze | 1x QSFP56 (obsługuje pasywne kable miedziane, aktywne optyczne i kable AOC) |

| Kluczowe cechy | PCIe Gen 4.0 x16 (kompatybilny również z Gen 3.0, 2.0; obsługuje konfiguracje x8, x4, x2, x1) |

| Opóźnienie | Poniżej mikrosekundy (typowe <0,7 µs)Częstotliwość komunikatów |

| Do 215 milionów komunikatów na sekundę | Szyfrowanie |

| Odciążenie sprzętowe XTS-AES 256/512-bitowe, gotowe do FIPS 140-2 | Format |

| Niskoprofilowa karta PCIe pionowa (zainstalowany wspornik wysoki, w zestawie akcesorium w postaci krótkiego wspornika) | Wymiary (bez wspornika) |

| 167,65 mm x 68,90 mm | Pobór mocy |

| Typowo 22 W – 24 W (zależy od wykorzystania łącza) | Wirtualizacja |

| SR-IOV (do 1K funkcji wirtualnych), VMware NetQueue, NPAR, odciążenie przepływu ASAP2 | Zarządzanie i monitorowanie |

| NC-SI, MCTP przez PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, pamięć flash SPI | Zdalne uruchamianie |

| InfiniBand, iSCSI, PXE, UEFI | Systemy operacyjne |

| RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 | Przewodnik wyboru – warianty kart ConnectX-6 |

| Porty | Maks. prędkość | Interfejs hosta | Kluczowe cechy | MCX653105A-HDAT |

|---|---|---|---|---|

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwuportowa 200 Gb/s | MCX653106A-HDAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwuportowa 200 Gb/s | MCX653105A-ECAT |

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwuportowa 200 Gb/s | MCX653106A-ECAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwuportowa 200 Gb/s | MCX653436A-HDAT (OCP 3.0) |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Mały format OCP 3.0, dwuportowa 200 Gb/s | Uwaga: MCX653105A-HDAT zawiera pełny silnik szyfrowania sprzętowego (XTS-AES) i obsługuje protokoły InfiniBand i Ethernet z prędkością do 200 Gb/s. W przypadku konfiguracji dwuportowych należy rozważyć warianty -HDAT z dwoma gniazdami QSFP56. |

- Jednoportowa konstrukcja zapewnia maksymalną przepustowość dla węzłów obliczeniowych, gdzie priorytetem jest wysoka gęstość na port.Wbudowane zabezpieczenia sprzętowe:

- Szyfrowanie blokowe XTS-AES bez obciążenia procesora, spełniające wymogi zgodności z FIPS dla branż regulowanych.Przyspieszone przechowywanie danych i AI:

- Odciążenia NVMe-oF i GPUDirect RDMA znacznie zwiększają wydajność treningu AI i pamięci masowej definiowanej programowo.Gotowość na przyszłość PCIe 4.0:

- Podwaja przepustowość połączeń z hostem, eliminując wąskie gardła dla sieci 200 Gb/s.Uproszczone zarządzanie:

- Zunifikowany stos sterowników (OFED, WinOF-2) i szeroka kompatybilność z systemami operacyjnymi zmniejszają złożoność wdrożenia.Serwis i wsparcie

Najczęściej zadawane pytania

• W przypadku platform chłodzonych cieczą, ta standardowa karta chłodzona powietrzem nie jest kompatybilna z wariantami z płytą zimną; skontaktuj się z Starsurge w celu uzyskania informacji o wariantach chłodzonych cieczą.

• Zawsze używaj kabli lub modułów klasy QSFP56, aby osiągnąć wydajność 200 Gb/s.

• Przed wdrożeniem upewnij się, że wersja sterownika jest zgodna z Twoim systemem operacyjnym i jądrem.

O Hong Kong Starsurge Group

Globalna dostawa · Wielojęzyczne wsparcie · Dostosowane usługi OEM i integracji

Kluczowe fakty w skrócie

| Status wsparcia | Uwagi | Przełączniki NVIDIA Quantum HDR InfiniBand |

|---|---|---|

| Dwupoortowa karta ConnectX-6 200 Gb/s (MCX653106A-HDAT) | Sieć 200 Gb/s, adaptacyjne routowanie | Przełączniki 200 GbE (IEEE 802.3) |

| ✓ Kompatybilny | Wymaga trybów FEC zgodnie ze specyfikacją przełącznika | GPU Direct RDMA |

| ✓ Tak | Seria GPU NVIDIA (Volta, Ampere, Hopper itp.) | VMware vSphere 7.0/8.0 |

| ✓ Certyfikowany | Sterowniki natywne, wsparcie SR-IOV | Linux (RHEL, Ubuntu, SLES) |

| ✓ Pełne wsparcie | MLNX_OFED, dostępne sterowniki wbudowane | Windows Server 2019/2022 |

| ✓ Obsługiwany | Pakiet sterowników WinOF-2 | Lista kontrolna kupującego – przed zamówieniem MCX653105A-HDAT |

- [ ] Sprawdź gniazdo PCIe serwera: fizyczne gniazdo x16, Gen 4 zalecane dla pełnej wydajności 200 Gb/s.

- [ ] Wybierz odpowiednie kable lub transceivery QSFP56 (pasywne miedziane do 5 m, AOC lub optyczne).

- [ ] Zweryfikuj wsparcie sterowników OS (wersja OFED lub wbudowana).

- [ ] Upewnij się, że wymagania dotyczące zgodności z szyfrowaniem są spełnione (XTS-AES, FIPS).

- [ ] Oceń chłodzenie środowiskowe: karty o wysokiej prędkości mogą wymagać ukierunkowanego przepływu powietrza.

- Powiązane produkty