Adapter NVIDIA ConnectX-7 VPI – dwuportowy NDR 400 Gb/s, PCIe 5.0, GPUDirect, RoCE – MCX75310AAS-NEAT

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MCX75310AAS-Neat (900-9x766-003n-SQ0) |

| Dokument: | Connectx-7 infiniband.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| Nr modelu: | MCX75310AAS-Neat (900-9x766-003n-SQ0) | Porty: | Pojedynczy port |

|---|---|---|---|

| Technologia: | Infiniband | Typ interfejsu: | OSFP56 |

| Specyfikacja: | 16,7 cm x 6,9 cm | Pochodzenie: | Indie / Izrael / Chiny |

| szybkość transmisji: | 400GBE | Interfejs hosta: | Gen3 X16 |

| Podkreślić: | Adapter sieciowy NVIDIA ConnectX-7,Dwuporotwa karta PCIe NDR 400 Gb/s,Adapter Mellanox RoCE GPUDirect |

||

opis produktu

MCX755106AS‑HEAT | Dwustronna karta Smart NIC PCIe 5.0

Przyspieszaj obciążenia związane ze sztuczną inteligencją, obliczeniami naukowymi i chmurą korporacyjną dzięki rodzinie NVIDIA ConnectX-7. MCX755106AS-HEAT zapewnia przepustowość do200 Gb/s InfiniBand (HDR) i elastyczność Ethernet 200 GbE, silniki obliczeniowe w sieci, zabezpieczenia na poziomie sprzętowym oraz ultra-niskie opóźnienia — wszystko zasilane przez PCIe 5.0.

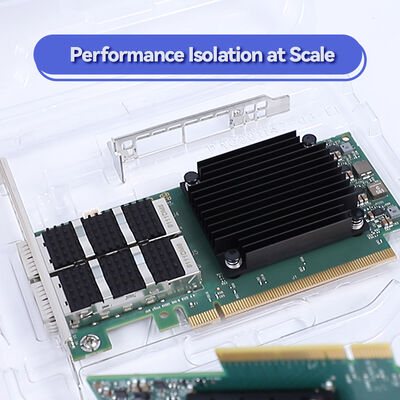

Adapter NVIDIA ConnectX-7 VPI MCX755106AS-HEAT to dwustronna, inteligentna karta sieciowa o przepustowości 200 Gb/s, przeznaczona dla klastrów obliczeniowych o wysokiej wydajności (HPC), fabryk AI i centrów danych przedsiębiorstw. Łącząc obsługę protokołów InfiniBand i Ethernet, umożliwia zdalny dostęp do pamięci bezpośredniej (RDMA), GPUDirect Storage oraz zaawansowane silniki obliczeniowe w sieci, takie jak SHARPv3 i offload protokołu rendezvous. Dzięki interfejsowi hosta PCIe 5.0 i akceleratorom bezpieczeństwa opartym na sprzęcie, ten adapter odciąża procesor, zmniejsza całkowity koszt posiadania (TCO) i zapewnia spójną wydajność przy niskich opóźnieniach.

Idealna dla organizacji modernizujących swoją infrastrukturę IT od brzegu sieci po rdzeń, rodzina ConnectX-7 zapewnia programowo definiowane, akcelerowane sprzętowo sieci, przechowywanie danych i zabezpieczenia — umożliwiając skalowalne i bezpieczne rozwiązania przy minimalnym narzucie.

ConnectX-7 integruje technologię NVIDIA ASAP² (Accelerated Switch and Packet Processing), aby zapewnić programowo definiowane sieci z prędkością linii bez zużywania rdzeni procesora. Wbudowane silniki sprzętowe obsługują szyfrowanie/deszyfrowanie dla IPsec, TLS i MACsec, chroniąc dane w ruchu od brzegu sieci po rdzeń. W przypadku przechowywania danych, wbudowany offload NVMe-oF i GPUDirect Storage umożliwiają bezpośredni ruch danych między pamięcią masową a pamięcią GPU, zmniejszając opóźnienia i maksymalizując przepustowość. Karta obsługuje również zaawansowaną synchronizację czasu (PTP z dokładnością 12 ns) i stronicowanie na żądanie (ODP) dla RDMA bez rejestracji, co czyni ją idealną dla architektur rozproszonych i skoncentrowanych na pamięci.

- Klastry AI i dużych modeli językowych (LLM): Szybkie połączenie dla serwerów GPU, wykorzystujące GPUDirect RDMA i offload operacji zbiorczych SHARP.

- Obliczenia o wysokiej wydajności (HPC): Sieć InfiniBand HDR 200 Gb/s dla MPI, OpenSHMEM i symulacji naukowych.

- Centra danych chmury hiperskalowalnej i SDN: RoCEv2, akceleracja nakładek i SR-IOV dla wirtualizacji wielodostępnej.

- Korporacyjna brama bezpieczeństwa: Wbudowane szyfrowanie MACsec/IPsec dla komunikacji od brzegu sieci do rdzenia z offloadem sprzętowym.

- Systemy przechowywania danych: Offload NVMe-oF/TCP, rozproszone platformy przechowywania danych wymagające ultra-niskich opóźnień i wysokiego IOPS.

✅ Systemy operacyjne: Sterowniki w zestawie dla Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (wtyczki CNI).

✅ Protokoły: InfiniBand (HDR/EDR), Ethernet (200 GbE do 10 GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS over RDMA, SMB Direct.

✅ Oprogramowanie pośredniczące HPC: NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM.

✅ Zarządzanie: NC-SI, MCTP over PCIe/SMBus, PLDM, Redfish, SPDM, bezpieczna aktualizacja oprogramowania układowego.

| Specyfikacja | Szczegóły |

|---|---|

| Model produktu | MCX755106AS-HEAT (NVIDIA ConnectX-7 VPI) |

| Maksymalna prędkość | InfiniBand HDR 200 Gb/s; Ethernet do 200 GbE |

| Konfiguracja portów | Dwustronny (obsługuje warianty 1/2 portu, ten model dwustronny QSFP56) |

| Interfejs hosta | PCIe 5.0 x16 (do 32 linii z rozwidleniem / Multi-Host) |

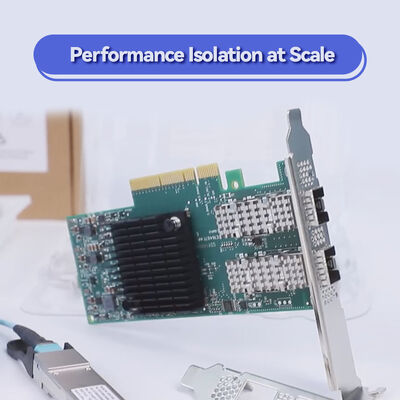

| Format | PCIe HHHL (Half Height Half Length) – standardowy wspornik |

| Obsługa protokołów | InfiniBand (HDR/EDR) i Ethernet (200 GbE/100 GbE/50 GbE/25 GbE/10 GbE) |

| RDMA | RoCE, RoCEv2, sprzętowy transport niezawodny, DCT, XRC, stronicowanie na żądanie (ODP) |

| Offload bezpieczeństwa | Wbudowany IPsec/TLS/MACsec (AES-GCM 128/256-bit), bezpieczne uruchamianie, szyfrowanie pamięci flash, uwierzytelnianie urządzenia |

| Offload przechowywania danych | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, XTS-AES 256/512-bit na poziomie blokowym |

| Czas i synchronizacja | IEEE 1588v2 (PTP), dokładność 12 ns, SyncE (G.8262.1), konfigurowalny PPS, planowanie wyzwalane czasem |

| Wirtualizacja | SR-IOV, akceleracja VirtIO, offload nakładek (VXLAN, GENEVE, NVGRE) |

| Zaawansowane funkcje | GPUDirect RDMA, GPUDirect Storage, offload SHARP, routing adaptacyjny, offload bufora pakietów |

| Zarządzanie i uruchamianie | UEFI, PXE, uruchamianie iSCSI, zdalne uruchamianie InfiniBand, PLDM, Redfish, SPDM, MCTP |

*Specyfikacje opierają się na publicznej dokumentacji NVIDIA. Przed złożeniem zamówienia zweryfikuj dokładną konfigurację dla swojego systemu.

| Model | Porty / Prędkość | Interfejs hosta | Główny cel |

|---|---|---|---|

| MCX755106AS-HEAT | 2-portowy InfiniBand HDR 200 Gb/s / 200 GbE | PCIe 5.0 x16 | Klastry AI, HPC, centra danych przedsiębiorstw |

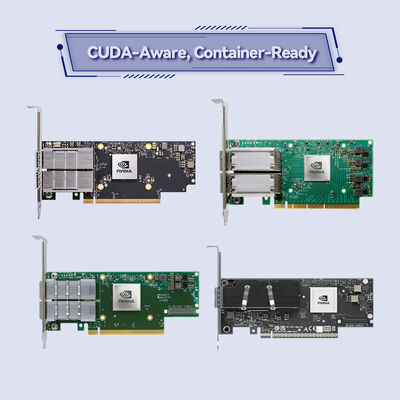

| MCX75310AAS-NEAT | 2-portowy InfiniBand NDR 400 Gb/s | PCIe 5.0 x16 | Zaawansowane AI, HPC na dużą skalę |

| Warianty OCP 3.0 | SFF / TSF z HDR/NDR | PCIe Gen5 | Serwery Open Compute Project |

- Ultra-niskie opóźnienia i wysoka przepustowość: Sprzętowe RDMA i obliczenia w sieci minimalizują opóźnienia końcowe aplikacji.

- Zunifikowana sieć: Jeden adapter obsługuje zarówno InfiniBand, jak i Ethernet, upraszczając inwentaryzację i wdrożenie.

- Przyszłościowy PCIe 5.0: 32 GT/s na linię, dwukrotna przepustowość PCIe 4.0, eliminująca wąskie gardła I/O.

- Zmniejszony TCO: Odciąża procesor od zadań sieciowych, przechowywania danych i bezpieczeństwa, umożliwiając bardziej efektywne wykorzystanie serwera.

- Zoptymalizowany pod kątem AI: Natywne GPUDirect i operacje zbiorcze SHARPv3 przyspieszają trenowanie i wnioskowanie modeli.

Hong Kong Starsurge Group Co., Limited zapewnia kompleksowe wsparcie, w tym konsultacje przedsprzedażowe, niestandardową konfigurację oprogramowania układowego i wysyłkę na cały świat. Wszystkie adaptery ConnectX-7 objęte są roczną gwarancją (z możliwością przedłużenia) i pomocą techniczną doświadczonych inżynierów sieciowych. Oferujemy wsparcie wielojęzyczne, usługi RMA i szybką logistykę wymiany, aby zminimalizować przestoje.

- Upewnij się, że gniazdo PCIe zapewnia wystarczającą moc (75 W przez gniazdo, brak dodatkowego zasilania wymaganego do standardowego działania).

- Sprawdź prześwit fizyczny: format HHHL pasuje do większości serwerów 1U/2U; warianty OCP wymagają odpowiedniego gniazda mezaniny.

- W przypadku wdrożeń RoCE, skonfiguruj DCB (Priority Flow Control) i ECN na przełącznikach dla sieci Ethernet bez strat.

- Zawsze aktualizuj oprogramowanie układowe do najnowszej stabilnej wersji, aby korzystać z ulepszeń bezpieczeństwa i wydajności.

Założona w 2008 roku, Hong Kong Starsurge Group Co., Limited jest dostawcą sprzętu sieciowego, usług IT i rozwiązań integracji systemów opartych na technologii. Obsługujemy klientów na całym świecie, oferując produkty takie jak przełączniki sieciowe, karty sieciowe, punkty dostępu bezprzewodowego, kontrolery, kable i sprzęt sieciowy. Nasz doświadczony zespół sprzedaży i techniczny wspiera branże takie jak rząd, opieka zdrowotna, produkcja, edukacja, finanse i przedsiębiorstwa. Dzięki podejściu stawiającemu klienta na pierwszym miejscu, Starsurge koncentruje się na niezawodnej jakości, responsywnej obsłudze i dopasowanych rozwiązaniach — pomagając klientom budować wydajną, skalowalną i niezawodną infrastrukturę sieciową.

Dostarczamy rozwiązania IoT, systemy zarządzania siecią, niestandardowe tworzenie oprogramowania, wsparcie wielojęzyczne i globalną dostawę. Wybierz Starsurge jako swojego zaufanego partnera w rozwiązaniach sieciowych NVIDIA.