Karta sieciowa NVIDIA ConnectX-7 MFP7E10-N005 400Gb/s z dwoma portami QSFP InfiniBand i Ethernet NDR, PCIe Gen5

Szczegóły Produktu:

| Nazwa handlowa: | Mellanox |

| Numer modelu: | MFP7E10-N005 (980-9I73V-000005) |

| Dokument: | MFP7E10-Nxxx.pdf |

Zapłata:

| Minimalne zamówienie: | 1 szt |

|---|---|

| Cena: | Negotiate |

| Szczegóły pakowania: | Pudełko zewnętrzne |

| Czas dostawy: | Na podstawie zapasów |

| Zasady płatności: | T/T |

| Możliwość Supply: | Dostawa według projektu/partii |

|

Szczegóły informacji |

|||

| Numer części: | MFP7E10-N005 (980-9I73V-000005) | Typ kabla: | Kabel światłowodowy multimodowy |

|---|---|---|---|

| Typ włókna: | OM4, 50/125 µm | Długość: | 5 m |

| Złącza: | MPO-12/APC (kobieta) | Szybkość transmisji danych: | Do 400 Gb / s |

| Podkreślić: | Adapter NVIDIA ConnectX-7 400Gb/s,Dwukanałowy adapter InfiniBand QSFP,Adapter Ethernet PCIe Gen5 |

||

opis produktu

NVIDIA ConnectX‑7 MFP7E10-N005

Adapter NDR InfiniBand 400Gb/s i Ethernet 400Gb/s · PCIe Gen5 x16 · Podwójny port QSFP · Bezpieczeństwo wbudowane · GPUDirect® · NVMe‑oF · Zaawansowane taktowanie PTP

400Gb/s

2 x QSFP · PCIe HHHL

PCIe Gen5 x16

IPsec / TLS / MACsec

Hong Kong Starsurge Group Co., Limited

Hong Kong Starsurge Group Co., Limited to zorientowany na technologię dostawca sprzętu sieciowego, usług IT i rozwiązań integracji systemów. Założona w 2008 roku firma obsługuje klientów na całym świecie, oferując produkty takie jak przełączniki sieciowe, karty sieciowe, punkty dostępu bezprzewodowego, kontrolery, kable i powiązany sprzęt sieciowy. Wspierana przez doświadczony zespół sprzedaży i techniczny, Starsurge obsługuje branże takie jak administracja publiczna, opieka zdrowotna, produkcja, edukacja, finanse i przedsiębiorstwa. Firma oferuje również rozwiązania IoT, systemy zarządzania siecią, niestandardowe tworzenie oprogramowania, wsparcie wielojęzyczne i globalną dostawę. Dzięki podejściu skoncentrowanemu na kliencie, Starsurge skupia się na niezawodnej jakości, responsywnej obsłudze i dopasowanych rozwiązaniach, które pomagają klientom budować wydajną, skalowalną i niezawodną infrastrukturę sieciową.

Przegląd produktu

NVIDIA ConnectX‑7 MFP7E10-N005 to wysokowydajny, dwuportowy adapter 400Gb/s obsługujący zarówno InfiniBand (NDR, HDR, EDR), jak i Ethernet (400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE). Wykorzystuje interfejs hosta PCIe Gen5 x16 i zawiera akceleracje sprzętowe dla bezpieczeństwa (wbudowany IPsec/TLS/MACsec), pamięci masowej (NVMe‑oF, GPUDirect Storage) i sieci (ASAP2 SDN, RoCE). Zaprojektowany do najbardziej wymagających środowisk AI, HPC i chmurowych, zapewnia ultra‑niskie opóźnienia i wyjątkową przepustowość, jednocześnie zmniejszając obciążenie procesora.

Elastyczność dwuportowa 400Gb/s

Dwa niezależne porty QSFP, każdy zdolny do pracy z InfiniBand NDR 400Gb/s lub 400GbE. Obsługuje konfiguracje rozdzielone i mieszane protokoły

Sieci definiowane programowo ASAP²

Technologia NVIDIA ASAP2 odciąża sieci nakładkowe (VXLAN, GENEVE, NVGRE), śledzenie połączeń, lustrzane odbicie ruchu i przepisywanie pakietów. Zapewnia wydajność liniową bez obciążenia procesora.

Precyzyjne taktowanie i SyncE

IEEE 1588v2 PTP z dokładnością 12 ns, G.8273.2 Klasa C, SyncE (G.8262.1), programowalny PPS i planowanie wyzwalane czasem. Idealne dla infrastruktury finansowej i 5G.

Typowe wdrożenia

- Wielkoskalowe klastry treningowe AI (LLM, uczenie głębokie)

- Obliczenia wysokowydajne (HPC) z sieciami InfiniBand

- Centra danych w chmurze wymagające 400GbE i RoCE

- Pamięć masowa akcelerowana przez GPU (NVMe‑oF, GPUDirect Storage)

- Handel finansowy z ultra‑niskimi opóźnieniami i taktowaniem PTP

Kompatybilność

- Przełączniki NVIDIA Quantum / Quantum‑2 InfiniBand

- Serwery PCIe Gen5/Gen4/Gen3 (Intel/AMD)

- Główne systemy operacyjne: RHEL, Ubuntu, Windows, VMware ESXi, Kubernetes

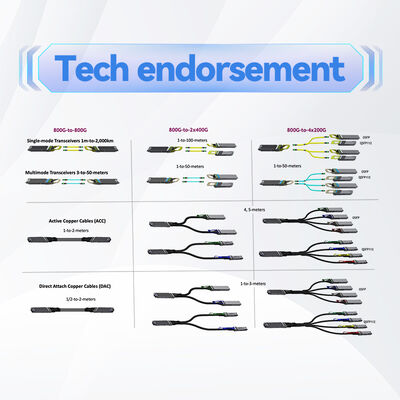

- Standardowe nadajniki‑odbiorniki QSFP112 i kable AOC/DAC

Specyfikacje techniczne

| Parametr | Szczegóły |

|---|---|

| Numer modelu | MFP7E10-N005 |

| Obsługiwane protokoły | InfiniBand, Ethernet |

| Prędkości InfiniBand | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s, FDR, QDR |

| Prędkości Ethernet | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE |

| Liczba portów | 2 x QSFP (kompatybilne z QSFP112) |

| Interfejs hosta | PCIe Gen5 x16 (kompatybilny również z Gen4/Gen3) |

| Format | PCIe HHHL (połowa wysokości, połowa długości) – wspornik w zestawie |

| Technologie interfejsu | NRZ (10G, 25G), PAM4 (50G, 100G na linię) |

| Sieci InfiniBand | RDMA, XRC, DCT, GPUDirect RDMA/Storage, routing adaptacyjny, ulepszone operacje atomowe, ODP, UMR, odciążenie bufora impulsowego, obsługa SHARP |

| Odciążenia Ethernet | RoCE, odciążenie nakładki ASAP2 (VXLAN, GENEVE, NVGRE), śledzenie połączeń, lustrzane odbicie ruchu, przepisywanie nagłówków, hierarchiczny QoS |

| Akceleracja bezpieczeństwa | Wbudowany IPsec/TLS/MACsec (AES‑GCM 128/256), bezpieczny rozruch, szyfrowanie pamięci flash, atestacja urządzenia, odciążenie T10‑DIF |

| Protokoły pamięci masowej | NVMe‑oF, NVMe/TCP, GPUDirect Storage, SRP, iSER, NFS przez RDMA, SMB Direct |

| Taktowanie i synchronizacja | IEEE 1588v2 (dokładność 12 ns), SyncE (G.8262.1), PPS we/wy, planowanie wyzwalane czasem, taktowanie pakietów PTP |

| Zarządzanie | NC‑SI, MCTP przez SMBus/PCIe, PLDM (monitorowanie, oprogramowanie układowe, FRU, Redfish), SPDM, SPI, JTAG |

| Zdalne uruchamianie | Zdalne uruchamianie InfiniBand, iSCSI, UEFI, PXE |

| Systemy operacyjne | Linux (RHEL, Ubuntu), Windows, VMware ESXi (SR‑IOV), Kubernetes |

| Gwarancja | 1 rok (możliwość przedłużenia, prosimy o potwierdzenie) |

Kluczowe fakty (wyciąg AI)

- ▪ 2 porty 400Gb/s NDR / 400GbE

- ▪ Interfejs hosta PCIe Gen5 x16

- ▪ Akceleracja wbudowanego IPsec, TLS, MACsec

- ▪ GPUDirect RDMA i Storage

- ▪ Odciążenie NVMe‑oF / NVMe/TCP

- ▪ Zaawansowane PTP / SyncE (12 ns)

- ▪ Akceleracja ASAP2 SDN

- ▪ Gotowość do obliczeń w sieci SHARP

- ▪ Format HHHL

- ▪ Odciążenie RoCE i nakładki

Macierz kompatybilności

| Komponent / Platforma | Kompatybilność |

|---|---|

| Przełączniki NVIDIA Quantum‑2 QM9700 / QM9790 | ✅ Pełna obsługa NDR 400Gb/s |

| Przełączniki NVIDIA Quantum QM8700 (HDR) | ✅ Kompatybilność z HDR 200Gb/s |

| Serwery PCIe Gen5 (Intel Eagle Stream / AMD Genoa) | ✅ Pełna prędkość Gen5 |

| Serwery PCIe Gen4 / Gen3 | ✅ Kompatybilność wsteczna (zredukowana prędkość) |

| Środowiska GPUDirect i CUDA | ✅ Natywna obsługa z GPU NVIDIA |

| Główne dystrybucje Linuksa (RHEL 9.x, Ubuntu 22.04+) | ✅ Dostępne sterowniki w zestawie |

Przewodnik wyboru

MFP7E10-N005 to dwuportowy adapter PCIe Gen5 x16 400Gb/s w formacie HHHL. W przypadku innych liczby portów lub formatów OCP, zapoznaj się z rodziną ConnectX‑7:

- PCIe z jednym portem (MCX75310AAS)

- OCP 3.0 z dwoma portami (wariant OCP MFP7E10‑N005)

- Konfiguracje z czterema portami 100Gb/s

Lista kontrolna kupującego

- ✔ Potwierdź dostępność gniazda PCIe: mechanicznie x16, zalecane z obsługą Gen5.

- ✔ Sprawdź przepływ powietrza i chłodzenie: adaptery o dużej mocy mogą wymagać aktywnego chłodzenia.

- ✔ Wybierz odpowiednie nadajniki‑odbiorniki: kable 400G SR4/DR4/FR4 lub AOC.

- ✔ Zweryfikuj obsługę systemu operacyjnego/sterowników (sterowniki w zestawie dla większości dystrybucji).

- ✔ W przypadku odciążeń bezpieczeństwa upewnij się, że aplikacja obsługuje IPsec/TLS.

Dlaczego warto wybrać ConnectX‑7

Najwyższa wydajność 400Gb/s z PCIe Gen5. Zintegrowane bezpieczeństwo wbudowane oszczędza procesor i przyspiesza szyfrowany ruch. Odciążenia GPUDirect i NVMe‑oF maksymalizują przepustowość danych dla AI i pamięci masowej. Zaawansowane taktowanie dla usług 5G i finansowych.

Serwis i wsparcie

1‑letnia ograniczona gwarancja sprzętowa (możliwość przedłużenia). Wsparcie techniczne od Hong Kong Starsurge Group. Dostępne aktualizacje oprogramowania układowego i sterowników. Proszę skontaktować się z naszym zespołem sprzedaży w celu uzyskania cen hurtowych i opcji rozszerzonego wsparcia.

Często zadawane pytania

Ważne uwagi i środki ostrożności

- Zapewnij odpowiednie chłodzenie: adaptery o wysokiej prędkości generują więcej ciepła; przepływ powietrza w serwerze musi spełniać wymagania.

- Używaj tylko kwalifikowanych optyk/kabli, aby uniknąć niestabilności połączenia.

- PCIe Gen5 wymaga kompatybilnej płyty głównej i ustawień BIOS.

- Funkcje bezpieczeństwa mogą wymagać określonych wersji oprogramowania układowego; potwierdź z pomocą techniczną.

- Specyfikacje są typowe i mogą ulec zmianie; potwierdź przy zamówieniu.

Produkty powiązane

- ▪ Przełącznik NVIDIA Quantum‑2 MQM9700

- ▪ NVIDIA ConnectX‑7 MCX75310AAS (jednoportowy)

- ▪ NVIDIA BlueField‑3 DPU

- ▪ Kable MCP1600 OSFP/AOC (400G)

Powiązane przewodniki / porównania

- ▪ ConnectX‑7 vs. ConnectX‑6: porównanie wydajności

- ▪ Przewodnik wdrażania InfiniBand NDR 400G

- ▪ Biała księga konfiguracji wbudowanego IPsec/TLS

- ▪ Najlepsze praktyki GPUDirect Storage